生成AIを利用したフェイクニュース流布による逮捕事案

2023年5月上旬、中国治安当局は生成AIで作成したフェイクニュースをインターネット上に掲載した男を逮捕したと発表しました。報道によれば、男は4月25日に中国北部甘粛省で鉄道事故により建設作業員9人が死亡した、という趣旨のフェイクニュースを作成し、公開していました。このニュースが中国インターネット大手「百度(バイドゥ)」のニュースブログで少なくとも25以上取り上げられており、15000回以上閲覧されていたとのこと。

現時点でどのようなフェイクニュース画面だったのか、は確認できないようになっていますが多くのブログユーザーが実際に事故が発生したと勘違いして拡散してしまったのですからよくできていたものなのでしょう。フェイクニュースの中でも読んだ瞬間に「嘘だろうな」とばれるようなものではなくいわゆるディープフェイクに分類されるものだったと推測されます。

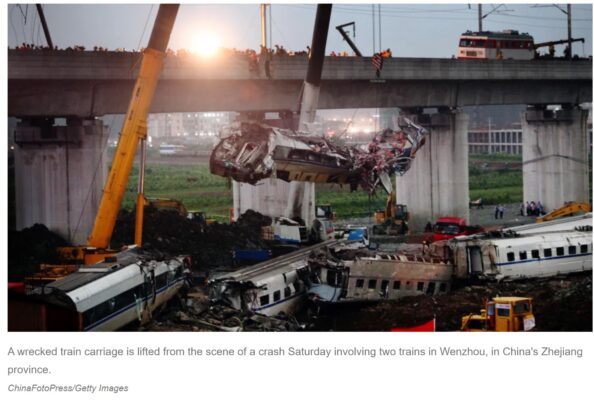

まだ生成AIが誕生していなかった2011年の浙江省温州市鉄道事故を筆頭に、中国国内ではたびたび鉄道事故が発生しているのは事実です。そしてそうした過去の情報がある以上、ChatGPTのような生成AIを使うことで、本当に起こったかのようなニュースを作成することは可能なのでしょう。

そして、情報機関の所属でもなく、特殊な研究に従事しているわけでもない一般の中国国民がニュースを作り、それを一般のネットユーザーが拡散するという事例が生じた以上他の国でも似たような事例は起こりうるでしょう。これから先海外のニュースはもちろんのこと、日本国内の出来事であっても本当にこれは事実なのか、を見極める眼力、リテラシーが求められる時代になったことを感じさせる事件でした。

生成AIの情報はいかにも「本物」っぽく見える、が…

さて、ChatGPTを含む生成AIがあちこちで話題になっています。生成AIを活用することで人類の社会構造が変わるかもしれない!というポテンシャルを評価する声もあれば、人間の仕事が放逐されかねないとして、業界によってストライキが発生する状況も生まれています(代表例はアメリカ映画産業の中心地ハリウッドです)。あるいは、精度の低い情報や誤った情報が提供されることによって社会に混乱が生じる、入力された様々な個人情報や機密情報が漏洩しかねないといった危険性を指摘する声もありますね。

近々広島で行われるG7でもこの生成AIの規制の在り方について岸田首相を議長として先進国の首脳が話しあうことになっているとも報じられています。インターネットを経由して数十億人という人が生成AIに触れかねない時代ですので世界的な議論が必要なのでしょう。

ではこの生成AIは絶対に正しいか、というと必ずしもそうではありません。特に日本語版では単純な質問を投げかけても明らかに誤りと思われる回答が返ってくることもしばしばあります。日本の有名なコメディアンである陣内智則さんはChatGPTにご自身のことを質問してみたらとんでもない間違い回答が返ってきた、ということを自身のyoutube動画で発表し「お笑いのネタ」としているほど。

公表されているプロフィール、それも基本中の基本とも言える年齢が全く違うという指摘から始まり、これまでの活躍履歴もまったく別ジャンルもまったくトンチンカンというところからスタートしています。その後もかみ合っていない回答が続きます。回答がもっともらしく見えるのですが、回答内容はかなり間違いが多いことが動画を見ればよくわかります。もっともらしい文章であるがゆえに陣内さんをご存じない方にとっては真偽の判断が難しくなってしまうかもしれません。

ただ、動画を見る限りこの動画で質問しているのは最新版ではなく、誰もが無料で利用できるGPT3.5 のようです。

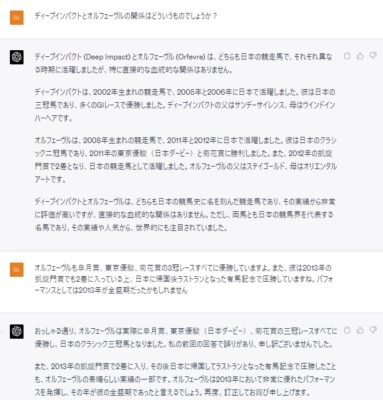

では、最新版かつ有料版となっているGPT4では正確性が上がっているのでしょうか?当サイトの代表尾崎が安全管理と同じくらい詳しいであろう競馬について質問して確認してみました。競馬というのはご存じかもしれませんが、競走馬の血統や過去数十年間のレース結果等かなり網羅的なデータが蓄積され、公開されている業界です。こうした過去の膨大なデータを踏まえて回答を作成する生成AIにはもってこいのテーマだと思います。

有料版を用いてみたものの、結果は↑の画像のようになりました。尾崎が回答の誤りを指摘するとChatGPTはすぐさま「訂正してお詫び申し上げます」と回答が返ってきたのは印象的でした。

これらから、ChatGPTについてはそもそもの正確性にはまだまだ課題があることもわかっていただけたのではないでしょうか。

ニュース事案や画像のファクトチェックはより一層慎重に

さて、ここまで最新テクノロジーの一つである生成AIの代表例、ChatGPTに絡んだ事件や現時点での能力をご紹介してきました。最後に今後生成AIの活用がますます広がった状態で海外での安全管理業務がどのような影響を受けるか考えてみましょう。

安全管理分野の情報収集は生成AIやフェイクニュースという言葉が生まれる以前から難易度の高いものでした。その上でさらに「もっともらしいけれど実は嘘でした」という情報が次々インターネット上に登場してくるとなるとその難易度はますます上がります。誤った情報(とはいえ本当のニュースと勘違いしてしまいかねない情報)に基づいて従業員や関係者の命に係わる判断を下す可能性がある、という想像をしただけで恐ろしいですね。

まず大前提として言えることはこれから先、治安や政治情勢に関わるニュースはファクトチェックの重要性が格段に上がるということが言えます。具体的には、インターネット上でもっともらしく提示されている動画や写真に付けられたキャプションが正確なものであるかどうかを冷静に確認しなければなりません。過去の動画やまったく別の地域で撮影された動画に今話題になっている事件のキャプションをつけるケースも少なくないからです。

例えばフランスの大手メディアFrance24はこれまでも独自にSNS上の動画や画像の解釈誤りなどを指摘する記事を定期的に公開しています。直近では、現地駐在中の日本人が自衛隊機も活用して退避したスーダンの混乱について分析した記事が公開されています。

今後は時期や場所の違う動画や画像だけでなく、AIがそれらしく作成した動画や画像も出回ってくる可能性があります。その際に登場する人物の服装や影、あるいは飲食料品のパッケージ、映り込んでいる風景などから本当に今事案が起こっている場所の正しい動画、画像なのかを判断しなければならない時代がもうすぐそこです。

特に関係者の命を預かる安全対策担当者は

数多く流れている情報だから正しい、

大手メディアが掲載している情報だから正しい、

有識者がコメントしているから正しい、

と何事もうのみにしてはいけないのです。自分の感情や、先入観は横に置いて、本当に間違いのない事実は何なのか?そしてそこから導き出される合理的な見解にどのようなものがあるのか、冷静に考えなければならないのです。

安全対策担当者の役割はメディアやインターネットで流れてくる情報を経営層にそのまま伝えることではありません。健全な疑問を持って、メディアに踊らされず、裏が取れている事実とそこから導き出されるいくつかのシナリオを伝える必要があるのです。

安全管理の世界で、(たとえ悪意がなくとも)誤った情報、生成AI等がでっち上げた情報が広まってしまうことは無理からぬこと。だからこそ、安全対策の担当者は緊急事態が発生した時こそ冷静にならなければなりません。どんなに派手なテロ事案が発生した際でも、どんなに世界的な大問題が発生しようとも、どんなに報道が過熱している時でも、氷のように冷静に、情報を多方面から集めて事実関係を検証しなければならないのです。

この項終わり